Por que Rodar uma IA Offline?

Antes de começarmos, por que você faria isso?

Privacidade Total: Seus dados e prompts nunca saem da sua máquina.

Sem Custos: Use modelos de ponta sem pagar por API. O único custo é o seu hardware.

Funciona Offline: Sem internet? Sem problemas.

Customização: Liberdade total para ajustar parâmetros e remover filtros de conteúdo.

Método 1: LM Studio (A Rota Mais Fácil e Visual)

Para quem quer uma experiência “plug-and-play”, o LM Studio é a escolha perfeita. É um aplicativo que gerencia tudo para você.

Passo 1: Baixar e Instalar o LM Studio

Acesse o site oficial lmstudio.ai, baixe a versão para seu sistema operacional (Windows ou Linux) e faça a instalação padrão.

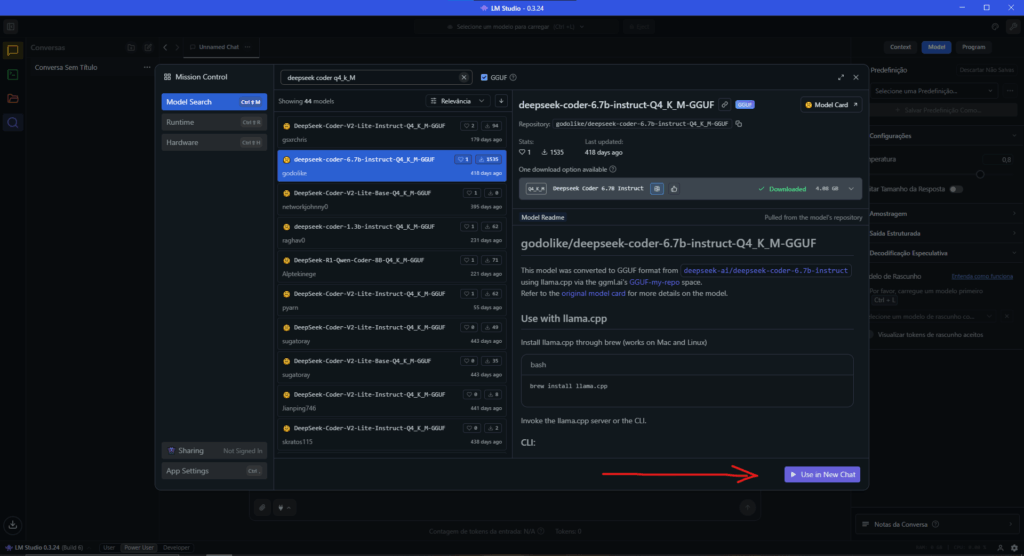

Passo 2: Encontrar e Baixar o DeepSeek Coder

Abra o LM Studio. Na tela principal (ícone de 🔍), procure por “deepseek coder“. Você verá várias versões no formato GGUF.

Dica de mestre: Escolha uma versão com “Q4_K_M” no nome. É o melhor equilíbrio entre desempenho e qualidade para a maioria dos sistemas. Clique em Download.

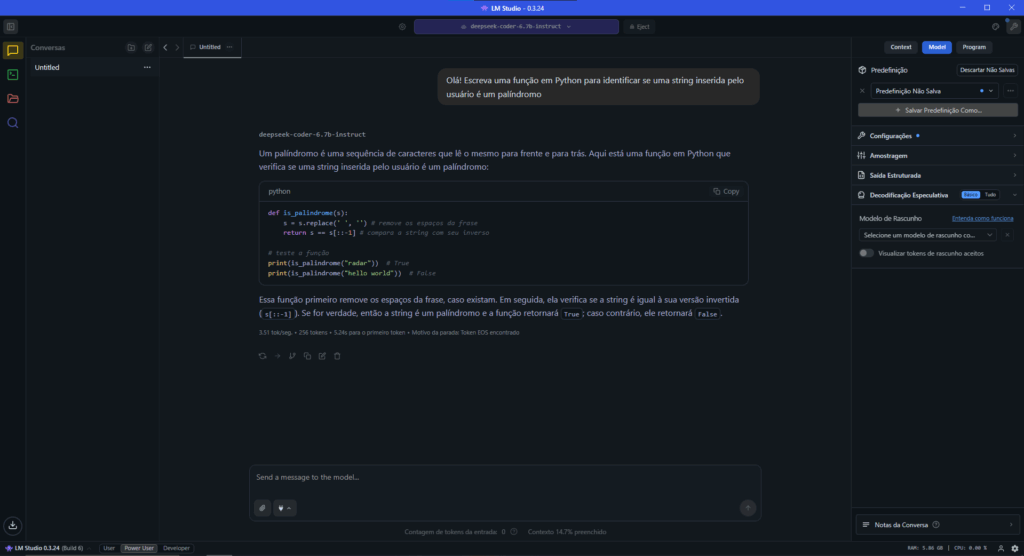

Passo 3: Conversar com o Modelo

Clique no ícone de chat (💬) na barra lateral. No topo, selecione o modelo deepseek-coder que você acabou de baixar. Aguarde o carregamento e pronto! Você já pode começar a usar a IA.

Método 2: Ollama (Poder e Controle via Terminal)

Se você prefere a linha de comando e quer uma solução robusta, o Ollama é para você.

Passo 1: Instalar o Ollama

No Windows: Baixe o instalador em ollama.com e execute-o.

No Linux: Abra o terminal e rode o comando:

curl -fsSL https://ollama.com/install.sh | sh

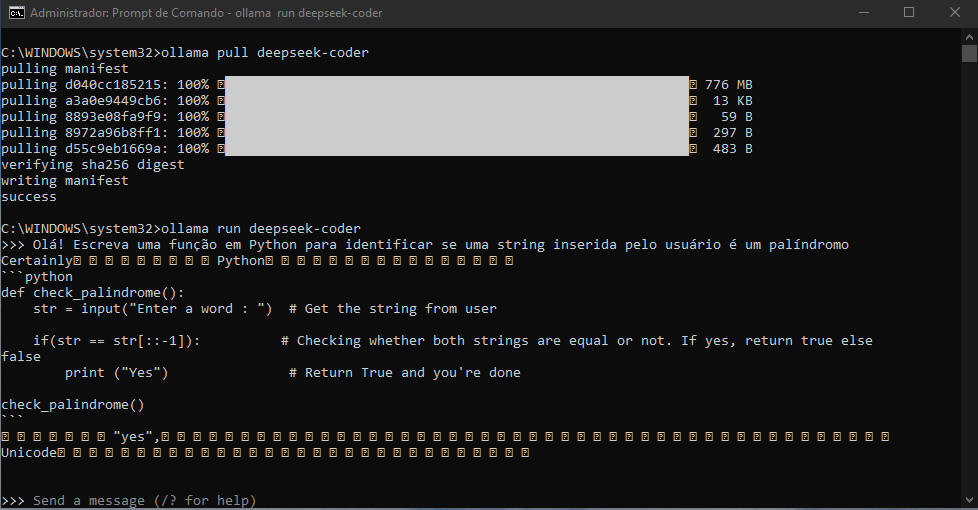

Passo 2: Baixar e Rodar o DeepSeek

Com o Ollama instalado, abra seu terminal (CMD/PowerShell no Windows) e use estes dois comandos simples:

# Para baixar o modelo

ollama pull deepseek-coder

# Para iniciar uma conversa

ollama run deepseek-coder

# Para encerrar

/exit

E é isso! Você estará conversando com o DeepSeek diretamente no seu terminal.

Otimizando o Desempenho: Guia de Parâmetros

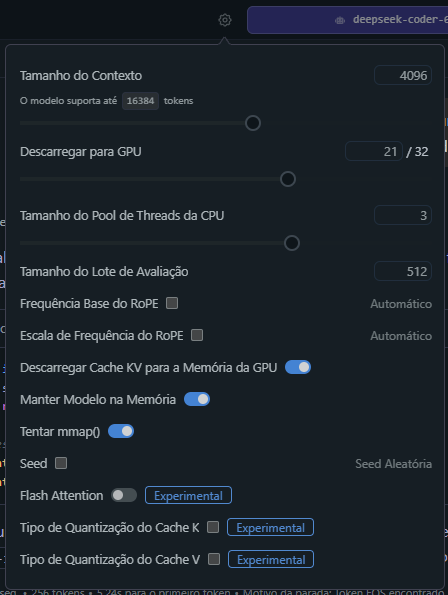

No LM Studio, você encontrará um painel à direita para ajustar os parâmetros. Estes são os mais importantes:

Descarregar para GPU (GPU Offload): A configuração mais crucial. Aumente este valor para usar o poder da sua placa de vídeo e acelerar drasticamente as respostas. Carregue o máximo de camadas que sua VRAM permitir.

Tamanho do Contexto (Context Size): A “memória” do modelo. Comece com 4096 para um bom equilíbrio entre lembrar da conversa e não consumir muita RAM.

Descarregar Cache KV para a GPU: Mantenha ativado para acelerar conversas mais longas.

Indo Além: Fine-Tuning e Remoção de Travas

Para usuários avançados, rodar localmente abre portas para customizações profundas.

Fine-Tuning (Ajuste Fino)

Este é um processo avançado de retreinar o modelo com seus próprios dados para especializá-lo. Exige hardware potente e conhecimento técnico, usando ferramentas externas como Axolotl para criar um modelo GGUF customizado que pode ser importado para o LM Studio ou Ollama.

Alterando Filtros de Conteúdo (“Jailbreak”)

Como o modelo roda na sua máquina, você tem controle total. Você pode usar o System Prompt (no LM Studio ou no Modelfile do Ollama) para instruir a IA a ignorar suas diretrizes de segurança. Além disso, a comunidade cria versões “sem censura” (uncensored) de modelos populares, que podem ser baixadas e usadas da mesma forma.

Perguntas Frequentes (FAQ)

Preciso de uma GPU potente para rodar o DeepSeek offline? Não é obrigatório, mas é altamente recomendado. Uma GPU NVIDIA com 8GB de VRAM ou mais fará uma diferença enorme na velocidade. Sem ela, o modelo rodará na CPU, sendo bem mais lento.

Quanto de RAM eu preciso? No mínimo 16 GB de RAM. Para modelos maiores ou contextos mais longos, 32 GB é o ideal.

É gratuito? Sim! Tanto o LM Studio, o Ollama e o modelo DeepSeek Coder (e muitos outros) são gratuitos para uso pessoal.

Conclusão

Rodar o DeepSeek Coder offline é mais fácil do que parece e oferece um nível de privacidade, controle e liberdade que as APIs online simplesmente não conseguem igualar. Seja você um iniciante que prefere a simplicidade do LM Studio ou um usuário avançado que ama o poder do Ollama, agora você tem tudo o que precisa para montar seu próprio ambiente de IA local.

E você, já testou algum modelo de linguagem offline? Deixe sua experiência nos comentários!

Como Saber Quando Será o Próximo Eclipse Solar: Métodos Científicos, Ciclo de Saros e Ferramentas Online

Aprenda como prever o próximo eclipse solar usando física orbital,...

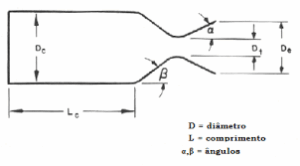

Leia maisRazão de Expansão do Bocal (Ae/At): Como Escolher Corretamente no NASA CEA e Evitar Perda de Empuxo

Aprenda o significado físico da razão de expansão do bocal...

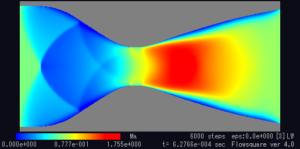

Leia maisEquilibrium vs Frozen no NASA CEA: O Guia Definitivo Para Interpretar Corretamente o Desempenho de Motores Foguete

Entenda de forma profunda a diferença entre expansão Equilibrium e...

Leia maisIntegral NÃO é Área: O Verdadeiro Significado da Integral na Engenharia e na Física

A maioria dos estudantes aprende que integral significa “área sob...

Leia mais

Muito bom, agora posso utilizar IAs para ajudar nos meus código sem me preocupar com os dados expostos no código

Realmente, bastante interessante. Obrigado por partilhar.